上个学期做的 端到端自动驾驶模型 研究最后结果不是特别让人满意,因素有很多。我只分析我自己的原因,其一是我上个学期处在某种诡异的极高强度 Coursework 以及拉不起来的效率叠加的没时间状态,我甚至感觉12月份期间,我的一天延长到36个小时都做不完工作。终于,以一场重感冒加缓考草草收场本学期。其二可以整体归因成我的经验还是太少了,犯了不少绕弯路的错误,不过某种意义上也是锻炼了我的能力。

方向的转变

这个学期不是很想接着玩那一块了,想玩个更本科生友好而且有意思的东西。于是盯上了 VL,L for LLM。LLM 不仅是个大热话题,目前人类,至少截止 2025 年,对 LLM 究竟能完成什么任务仍然是不够清楚的。

抽象的思维也许不需要自然语言作为载体,但是复杂的 CoT 我确实想不到如何不用自然语言为载体。但值得注意的是,很多复杂的现实任务也许是需要某种抽象的语义理解和推理来实现的。LLM 能不能,如何能融入辅助流程的某一个步骤,是一个在我看来一个非常前沿而且黑盒的领域。

SLAM 的探索

HQ 那边给我分配的是叫我把 VL 融入 SLAM(Simultaneously Locating and Mapping),Okay,虽然有着浓浓的横向课题嫌疑,但是好歹算是一个有意义的方向。讨论了很多,主要还是围绕着 VL 的黑盒性质展开。这太新了,别说 survey 了,连一篇像样的工作都没有。

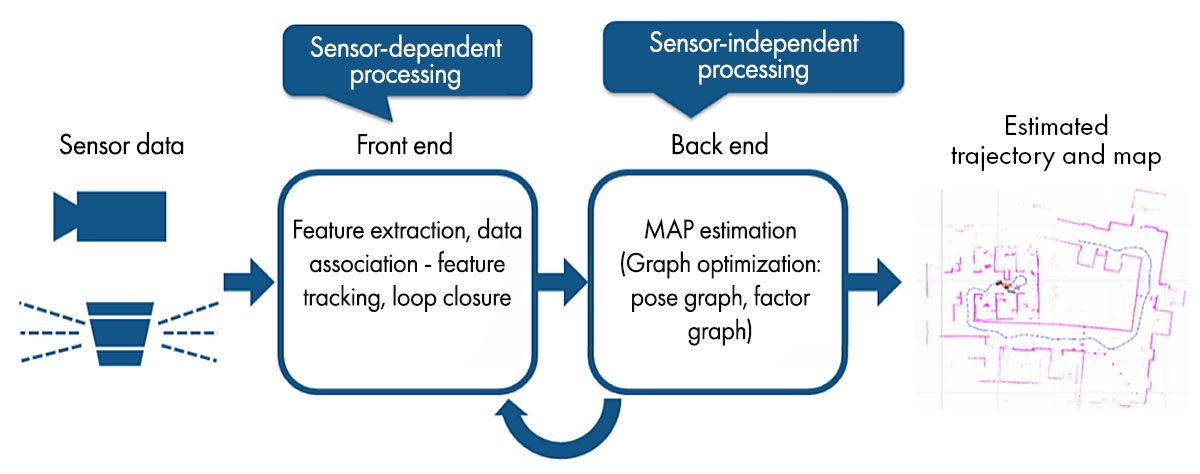

SLAM处理流程,包括前端传感器信号处理和后端位姿图优化 图片来源:MathWorks

SLAM处理流程,包括前端传感器信号处理和后端位姿图优化 图片来源:MathWorks

做的最工程的 VL 进模型是 NeurIPS2025 的 AutoVLA from UCLA。抛开这个是 Action 为导向不谈,他们甚至到目前也没有公布源代码,即使他们说了会在去年12月放出来💦。我们只能自己摸索,而且这个摸索的对象甚至是范式级别的。就比如说,到底是 G(SLAM(x) + VL(x)) 还是 SLAM(x + VL(x))?

组内 Brainstorm 了很多 approaches,虽然有一些很天马行空或者工程量爆炸。讨论到最后最快落地的方法甚至是把别人的 VL-Navigation 工作的模型头拔掉魔改成 SLAM 任务头。

后续计划

有个好消息,我这个寒假会一直待在 深圳,同时我下个学期的课业压力目测会减半,我会有大量的时间展开这一块的工作。我这周也许会再探索一下更多工作,复现一些东西,也许会摆一会弥补期末周给我带来的深度掏空。

不管怎么说,我觉得这份研究有意思多了,一部份由于它更加抽象,客观意义的那种抽象,以及某种探索未知的兴奋和自由。

Stay tuned!